MI300X GPU 32개 활용한 4노드 구성에서 H100 기반 시스템 대비 24% 높은 성능 보여

망고부스트가 글로벌 AI 성능 평가 벤치마크인 MLPerf Inference v5.0에서 새로운 추론 성능 기록을 달성하며, AI 인프라 솔루션 경쟁력을 입증했다.

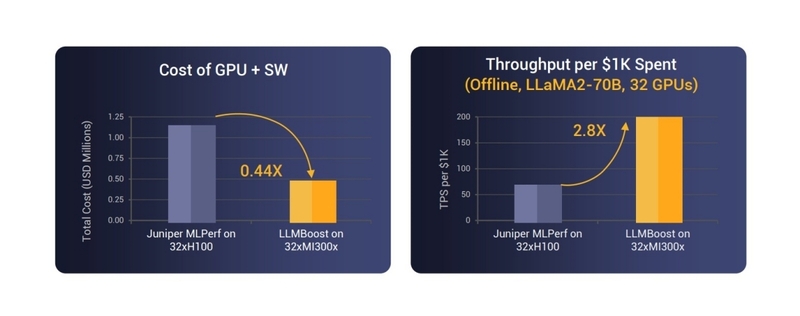

망고부스트는 AMD Instinct MI300X GPU 기반의 추론 최적화 소프트웨어 ‘Mango LLMBoost’로 Llama2-70B 모델의 오프라인 시나리오에서 역대 최고 TPS(초당 토큰 처리량)를 기록했다. 이번 결과는 MI300X GPU 32개를 활용한 4노드 구성에서 나왔으며, NVIDIA H100 기반 시스템 대비 24% 높은 성능을 보여주며 AI 인프라 시장에 새로운 대안을 제시했다. 특히 비용 대비 성능비에서 2.8배의 경쟁력을 보이며, 특정 하드웨어에 의존하지 않고 고성능·고효율 AI 추론을 구현할 수 있는 가능성을 입증했다.

망고부스트의 Mango LLMBoost는 서버 시나리오에서 9만3039 TPS, 오프라인 시나리오에서 10만3182 TPS를 달성했다. 이는 이전 최고 기록인 8만2749 TPS를 크게 웃도는 수치다. 하드웨어 가격 또한 MI300X가 H100 대비 최대 62% 저렴해 기업 입장에서는 더 낮은 비용으로 더 높은 성능을 확보하게 된 셈이다. 이러한 성과는 AMD와의 긴밀한 협업 아래 ROCm 소프트웨어 최적화를 통해 이뤄졌으며, 단일 노드에서 다중 노드 클러스터까지 확장 가능한 구조로 설계돼 다양한 AI 데이터 센터 환경에 쉽게 적용 가능하다.

망고부스트는 AWS 환경에서도 성능을 입증했다. 8개의 NVIDIA A100 GPU 환경에서 Ollama 대비 최대 138배 빠른 추론 속도를 기록했으며, Hugging Face TGI와 vLLM 등 주요 AI 프레임워크 대비 성능 우위를 유지했다. 비용 측면에서도 Ollama 대비 99%, vLLM 대비 30% 이상 절감 효과를 보였다.

Mango LLMBoost는 Llama, Qwen, DeepSeek 등 50개 이상의 오픈소스 모델을 지원하며, 도커 기반의 원라인 배포 및 OpenAI 호환 API를 제공한다. AWS, Azure, GCP는 물론 온프레미스 환경에서도 적용할 수 있도록 설계돼 있다.

망고부스트 김장우 대표는 “MLPerf Inference v5.0 결과는 망고부스트의 기술력이 글로벌 무대에서 인정받았다는 의미”라며, “DPU 기반 하드웨어와 AI 추론 소프트웨어의 통합 풀스택 솔루션으로 AI 데이터 센터의 성능과 비용 문제를 동시에 해결하겠다”고 말했다. 망고부스트는 AI 추론뿐 아니라 RDMA 네트워킹, 스토리지 가속 등 다양한 최적화 기술을 개발하며, AI 인프라 표준화를 향한 풀스택 기술기업으로 입지를 강화하고 있다.

헬로티 서재창 기자 |