[첨단 헬로티]

임베디드 비전 시스템 성능 최적화 할 수 있는 이미지 센서 선택해야

인더스트리 4.0의 협업 로봇에서부터 화재와 싸우거나 농업에 사용되는 무인 항공기, 생체 인식 얼굴 인식 및 집안의 의료 기기 (point-of-care hand-held medical devices)에 이르기까지 새로운 이미징 애플리케이션이 급성장하고 있다. 이러한 새로운 응용 프로그램의 출현을 가능하게 하는 핵심 요소는 임베디드 비전이 이전보다 더욱 쉽게 액세스할 수 있게 되었다는 것이다. 임베디드 비전은 새로운 개념이 아니라 외부 컴퓨터 없이 비전 설정을 포함한 데이터를 제어하고 처리하는 비전시스템이라고 정의할 수 있다. 일반적으로 "스마트 카메라"라고 불리는 형태로 산업 품질 관리에 널리 사용되고 있다.

최근에는 소비자 시장을 위해 개발된 저렴한 하드웨어 구성 요소의 가용성으로 인해 컴퓨터에 비해 BOM(bill-of-material) 및 크기가 크게 감소하고 있다. 소규모 개발 업체/OEM들은 NVIDIA Jetson과 같은 단일 보드 컴퓨터 또는 시스템을 소량으로 구할 수 있지만 대형 OEMS들는 Qualcomm Snapdragon 또는 Intel Movidius Myriad 2와 같은 이미지 신호 프로세서를 이용하여 직접 공급할 수 있게 되었다. 소프트웨어 수준 기성품 소프트웨어 라이브러리는 특정 비전시스템을 훨씬 더 빨리 개발하고 배포하기 쉽도록 만들어지고 있다.

임베디드 비전시스템의 성장을 가속화하고 있는 두 번째 변화는 실험실 수준의 신경망을 학습하고 프로세서에 직접 업로드하여 자율적으로 기능을 식별하고 실시간으로 의사 결정을 내릴 수 있는 기계 학습(Machine Learning)의 출현이다.

임베디드 비전에 적합한 솔루션을 제공하는 것은 이러한 고성장 애플리케이션을 목표로 삼는 이미징 업계의 기업에게 매우 중요하다. 임베디드 비전 시스템의 성능과 디자인에 직접적인 영향을 미치는 이미지 센서는 더 중요한 역할을 요구 받고 있으며 그 중요성은 핵심 크기, 무게, 전력 및 비용 감소를 의미하는 SWaP-C 로 요약할 수 있다.

1. 비용절감의 중요성

임베디드 비전의 새로운 사용을 위한 중요한 변화 요건은 비전시스템의 가장 강력한 제약인 시장에서 수용 가능한 가격을 충족시킬 수 있냐는 것이다.

1.1. 광학비용 절감

비전 모듈의 비용을 절감하는 첫 번째 방법은 이미지 센서 픽셀 크기가 줄여서 동일한 웨이퍼에 더 많은 칩을 넣는 방법으로 고유한 실리콘 비용이 줄어들고, 두 번째로 센서를 더 작고 저렴하게 만드는 것이다. 예를 들어 픽셀 크기를 2.8μm로 줄이면, Teledyne e2v의 Emerald 5M이미지 센서의 경우, S- 마운트(M12) 광학을 5MP 글로벌 셔터 센서에 채용하여 M12 렌즈의 비용을 약 10달러로 줄일 수 있으므로 직접 비용을 절감할 수 있다. 일반적으로 C 마운트 또는 F 마운트 광학과 같은 대형 광학 포맷은 10 배에서 20 배 높은 가격이 책정되므로 공간을 줄이는 것이 임베디드 비전 시스템 비용을 절감하는 효과적인 방법이다.

일반적으로 이미지 센서 제조업체에서는 광학 설계 비용이 낮게 하려고 센서의 입사각이 줄어든다. 저비용 광학 기기 설계에서는 왜곡을 보상하고 광각에서 오는 빛을 집중시키기 위해 픽셀 위에 배치된 특정 이동 된 마이크로 렌즈의 설계가 필요하다.

1.2. 센서 수준에서 비용 효율적인 인터페이스

광학 최적화 외에도 센서 인터페이스의 선택은 비전 시스템 비용에 간접적으로 영향을 미친다. MIPI CSI-2 인터페이스는 인터페이스 유도 비용 절감을 가능하게 하는 가장 적합한 방법이다. (MIPI 얼라이언스가 원래 모바일 업계 용으로 개발한 것임). 대부분의 ISP에서 광범위하게 채택되었으며 NXP, NVIDIA, Inc.의 비용 효과적인 SoC (System-on-Chip) 또는 SOM (System-on-Module)에 린 (lean) 통합을 제공하므로 산업 시장에 채택되기 시작했다.

Qualcomm 또는 Intel 및 기타 MIPI CSI-2 센서 인터페이스로 CMOS 이미지 센서를 설계하면 중간 컨버터 브리지없이 이미지 센서에서 임베디드 시스템의 호스트 SOC 또는 SOM으로 직접 데이터를 전송할 수 있으므로 비용과 PCB에서 차지하는 면적을 줄일 수 있다. 다수의 이미지센서를 기반으로 하는 임베디드 시스템에서(360° vision) 더욱 효과를 발휘할 수 있다.

이러한 이점에도 MIPI 인터페이스는 연결 거리가 20cm로 제한되어 있어 센서가 호스트 프로세서에서 먼 곳에 있는 원격 헤드 설정에 적합하지 않을 수 있다. 이러한 구성에서는 소형화보다는 더 긴 인터페이스를 통합하는 카메라 보드 솔루션을 사용하는 것이 합리적이다. FLIR, AVT, Basler 등과 같은 산업용 카메라 제조업체의 카메라 보드에서는 MIPI 또는 USB3 인터페이스를 통해 3m ~ 5m까지 작동 할 수 있다.

1.3. 개발 비용 절감

새로운 제품에 투자할 때 개발 비용이 상승하는 경우가 발생한다. 이러한 경우에는 NRE (Non-Recurring Expenses)로 수백만 달러의 비용이 소요되고 출시 기간에 대한 부담이 생긴다. 임베디드 비전의 경우, 이러한 개발 비용의 상승이 양산 시의 모듈화에 필요성이 더해지고, 제품개발/통합에 중요한 가치가 되고 있다. 다행히도 최근에는 동일한 픽셀 아키텍처를 공유할 수 있는 구성 요소를 정의하여 전기 광학 성능을 안정화 시킬 수 있는 동일 요소를 공유함으로써 센서 간 호환성을 제공하고, 이러한 설계를 통해 센서를 평가, 통합하거나 양산 시의 공급망을 최적화 할 수 있는 호환 가능한 PCB 어셈블리를 제공하면서 개발비 및 생산비를 낮출 수 있다.

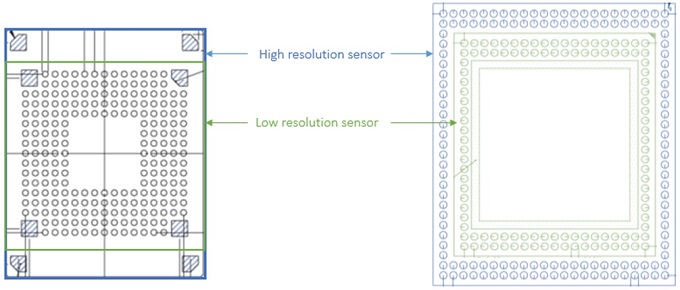

모듈식 카메라 보드 (여러 센서에 적용 가능)의 설계를 쉽게 하기 위해 센서 패키지를 설계하는 두 가지 방법이 있다. Pin-to-pin 호환성은 카메라 보드 설계자에게 가장 선호되는 옵션이다. 여러 센서가 정확히 동일한 전기 패드와 컨트롤을 공유하기 때문에 PCB 디자인 관점에서 가장 명확한 방법이다. 대안으로, 풋 프린트 호환 센서를 제공함으로써 PCB 설계자는 여러 센서에 대해 단일 PCB를 채용할 수 있다. 그러나, 이 경우에는 각 센서에 대해 여러 개의 접촉 패드를 예상 해야 하고 이에 따른 PCB라우팅을 예측해야 한다.

그림1. 이미지 센서 플랫폼은 핀 - 투 - 핀 호환성 (왼쪽) 또는 풋 프린트 호환성 (오른쪽)을 제공하여 고유 한 PCB 레이아웃 디자인을 가능하다.

2. 자율성을 높이기 위한 에너지 효율 대책

소형 배터리로 구동되는 장치는 임베디드 비전의 혜택을 받는 가장 명백한 응용 애플리케이션이다. 시스템의 에너지 소비를 줄이기 위해 이미지 센서에는 시스템 설계자가 전력을 절약할 수 있는 많은 기능이 포함되어 있다.

센서측면에서 획득 프레임 속도를 감소시키지 않고 내장된 비전 시스템에서 전력 소비를 줄이는 여러 가지 방법이 있다. 센서 자체의 전력 소비를 줄이기 위해 가능한 한 많이 센서 대기 및 유휴 모드를 사용하여 시스템의 동적 작동을 최소화하는 것이 가장 간단한 방법이다. 특히 대기 모드는 센서의 아날로그 회로를 끄면 센서의 전력 소비를 기능 모드의 2 %까지 줄일 수 있다. 유휴 모드는 전력 소비의 약 절반을 절약하고 마이크로 초 단위로 이미지를 수집하도록 센서를 준비할 수 있다.

전력을 절감하는 또 다른 방법은 최신 리소그래피 기술를 사용하여 센서를 설계하는 것이다. 노광 해상도 가 작아질 수록 트랜지스터를 스위칭 하는 데 필요한 전압이 낮아지고 전압 스퀘어 (P_dynamicαC × V²)에 비례하므로 동적 전력 소모가 낮아진다. 따라서 10 년 전에 180nm 기술을 사용하던 픽셀은 트랜지스터를 110nm로 줄임으로써 사이즈가 작아졌을 뿐만 아니라 디지털 회로의 전압도 1.8V에서 1.2V로 감소시켰다. 차세대 센서에서 65nm기술은 임베디드 비전 애플리케이션을 위한 더 많은 전력 절감을 제공하는 데 사용될 예정이다.

마지막으로, 이미지 센서는 특정 조건에서 LED의 에너지 소비를 줄이기 위해 적절하게 선택될 수 있다. 3D 맵을 생성하거나, 동작을 정지시키거나, 순차적으로 특정 파장에 동기화하여 콘트라스트를 높일 수 있다. 이러한 경우 이미지 센서는 밝지 않은 상황에서 작동할 때 센서의 소음을 낮춤으로써 절전상태를 유지할 수 있다. 엔지니어는 센서 노이즈를 낮춤으로써 내장형 비전 시스템에 통합된 LED의 전류 강도 또는 LED 수를 줄일 수 있다.

이미지 캡처 및 LED 플래시가 외부 이벤트에 의해 트리거되는 다른 조건에서 적절한 센서 판독 구조를 선택하면 상당한 전력을 절약 할 수 있다. 기존의 롤링 셔터 센서는 프레임의 전체 노출 동안 LED를 계속 켜놓아야 하지만 글로벌 셔터 센서는 해당 프레임에 대해서만 조명을 킬 수 있다. 롤링에서 글로벌 셔터 이미지 센서로의 전환은 조명 비용 절감을 유도하는 한편, 픽셀 내 CDS (Correlated Double Sampling)를 사용하는 경우 현미경에 사용되는 CCD 센서만큼 낮은 잡음을 유지할 수 있다.

3. 비전 어플리케이션 시스템 설계를 위한 온칩 기능

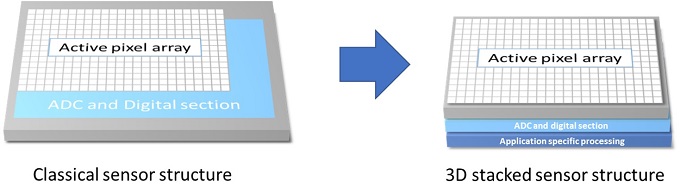

이러한 임베디드 비전 개념의 최종 목표는 성능 및 전력 소비를 최적화하기 위해 3D 스택 방식으로 모든 프로세싱 기능 (System-On-Chip)을 통합하는 이미지 센서의 개발로 이어질 것이다. 그러나 이러한 제품을 개발하는 데 드는 비용이 많이 들것이고 일부 커스토마이즈 제품에 특화되고 있다. 오늘날에는 특정 기능만을 직접 임베딩하는 중개 단계에 있고, 센서는 계산 부하를 줄이고 처리 시간을 고정시킬 수 있다.

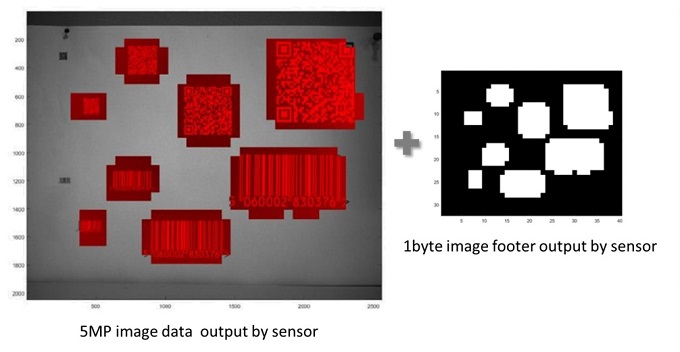

예를 들어, 바코드 판독 응용 프로그램에서 Teledyne e2v는 센서 칩에 추가된 내장 기능에 대한 특허를 보유하고 있다. 이 기능에는 해당 프레임에서 바코드의 영역을 자동으로 인식하여 바코드의 위치를 파악할 수 있어서 ISP는 이 영역에만 초점을 맟추어 데이터를 보다 효율적으로 처리할 수 있다.

그림 2. TELEDYNE E2V SNAPPY5M SENSOR의 자동 바코드 영역탐색기능

처리 부하를 줄이고 데이터를 최적화하는 기능의 또 다른 예는 Teledyne e2v의 특허인 고속 노출 모드다. 이 모드는 조명 조건이 변할 때 포화를 피하기 위해 센서가 자율적으로 노출 시간을 보정할 수 있다. 이 기능은 단일 프레임에서 조명의 변동에 따른 처리 시간을 최적화할 수 있다. 이 기능으로 프로세서가 처리해야 하는 이미지의 양을 최소화합니다.

이러한 특수 기능은 고객의 응용 프로그램에 대한 이해를 필요로 한다. 애플리케이션의 이해도에 따라서 임베디드 비전 시스템을 최적화하기 위한 여러 온칩(On-Chip) 기능을 설계할 수 있다.

4. 이미지 시스템의 소형화

임베디드 비전 시스템의 주요 요구 사항은 소형 공간에 적합하거나 가볍고 핸디 장치에 적합하거나 배터리 구동 엔진을 최대화하는 것이다. 그렇기 때문에 오늘날 대부분의 임베디드 비전 시스템은 1MP ~ 5MP의 제한된 해상도의 소형 광학 포맷 센서를 사용한다.

픽셀 어레이의 크기를 줄이는 것은 이미지 센서의 공간과 무게를 줄이는 첫 번째 방법이다. 오늘날 65nm 공정을 통해 전기 광학 성능을 손상시키지 않으면서 글로벌 셔터 픽셀 피치를 2.5μm까지 줄일 수 있다. 이러한 제조 공정은 풀 HD 글로벌 셔터 CMOS 이미지 센서와 같은 제품, 즉 휴대 전화 시장에서와 동일한 포맷, 즉 1/3"미만의 제품으로 이어진다.

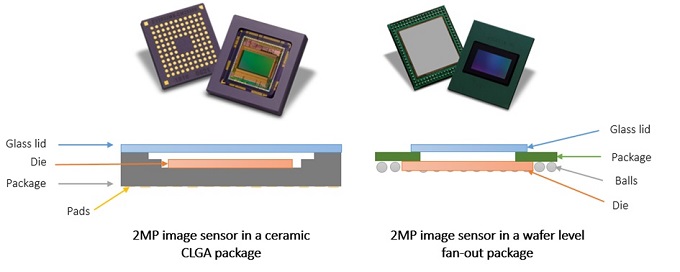

센서 무게와 공간을 줄이기 위한 또 다른 핵심 기술은 패키지의 크기를 줄이는 것이다. 웨이퍼 레벨 패키지는 수년간 시장에서 급속한 성장을 이루고 있다. 특히 모바일, 자동차 및 의료용 어플리케이션에 적합하고, 산업 시장에서 사용되는 고전적인 CLGA (Ceramic Land Grid Array) 패키지와 비교하여 웨이퍼 레벨 팬 아웃 패키지는 고밀도 연결을 제공하며 임베디드 시스템 용 소형 및 경량 이미지 센서를 생산하는 데 탁월한 솔루션이다. Teledyne e2v Emerald 2M 센서의 웨이퍼 레벨 패키지는 동일 제품의 세라믹 패키지 대비 두 배 얇고 표면적을 30 % 줄였다.

그림 3. 풋 프린트, 두께 및 비용을 줄이기 위해 CLGA 패키지 (왼쪽)와 웨이퍼 레벨 팬 아웃 유기 패키지 (오른쪽)로 조립 된 동일한 다이.

미래를 내다 볼 때 우리는 임베디드 비전 센서의 크기를 더욱 줄일 수 있는 또 다른 기술을 기대할 수 있다.

3D 스태킹은 개별 웨이퍼에 다른 회로 블록을 제조한 다음 Cu-Cu 연결 및 TSV (Through Silicon Vias)를 통해 스태킹하고 상호 연결함으로써 반도체 구성 요소를 만드는 혁신적인 기술이다. 3D 스태킹은 레이어들을 겹치게 할 수 있으므로 기존 센서보다 작은 설치 공간으로 장치를 만들 수 있다. 3D 스태킹 이미지 센서에서, 판독 및 처리 블록은 픽셀 어레이 및 로우 디코더 아래로 이동될 수 있다. 따라서 판독 및 처리 블록의 표면에 의해 차지하는 공간이 줄어들고 이미지 신호 프로세서를 언로드하기 위해 센서처리 능력을 추가 할 수 있는 가능성이 생긴다.

그림 4. 3D 칩 스태킹 기술은 픽셀 어레이, 아날로그 및 디지털 회로를 오버랩 할 수 있으며 심지어 애플리케이션 프로세싱을 추가할 수 있다.

그러나 3D스태킹 기술은 은 현재 이미지 센서 시장에서 널리 채택되기 위해 몇 가지 과제에 직면해 있다. 실리콘 비용을 3 배 이상 증가시킬 뿐만 아니라 추가 프로세스가 필요하므로 해당 기술에 대한 리스크와 비용문제가 극복되어야 한다. 따라서 3D스태킹은 주로 고성능 또는 매우 작은 풋 프린트 임베디드 비전 시스템을 위한 옵션이 될 것이다.

결론적으로 임베디드 비전을 수행하는 것은 "린(lean)"비전으로 요약될 수 있으며 OEM, 시스템 통합 업체 및 표준 카메라 제조업체를 포함한 많은 회사에서 적용할 수 있다. "임베디드"는 많은 응용 프로그램에서 사용되는 일반적인 용어로, 단일 사양으로 설정하기가 어렵다.

그러나 주요 시장은 일반적으로 최고 수준의 속도 또는 민감도가 아니라 크기, 무게, 전력 및 비용에 의해 좌우되기 때문에 임베디드 비전 시스템을 최적화하는 데 몇 가지 규칙이 적용된다. 이미지 센서는 이러한 매개 변수에 중요한 기여를 하고 있으며 전반적인 임베디드 비전 시스템 성능을 최적화 할 수 있는 이미지 센서를 선택할 때에는 주의가 필요하다. 올바른 이미지 센서는 임베디드 비전 디자이너가 BOM(bill-of-material)뿐만 아니라 조명 및 광학 영역의 풋 프린트를 줄일 수 있는 보다 많은 자유를 제공한다. 또한 복잡성을 추가하지 않고도 소비자 시장에서 저렴하고 심층적으로 최적화 된 이미지 신호 프로세서를 선택할 수 있다.

Marie-Charlotte Teledyne e2v